随着大模型训练与推理规模持续扩大,AI 加速卡正快速迈入超高功耗、超大电流、超低电压的新阶段。

以NVIDIA H200 为代表的新一代 AI GPU,已经将单卡功耗推升至 700W 级别,真正的挑战,正在从“算力本身”转向系统级供电稳定性(Power Delivery Network, PDN)。在这一背景下,被动元件,尤其是电容器,正在从幕后走向核心位置。

H200带来的三大现实痛点

对硬件工程师而言,H200 并不仅仅是一颗更强的 GPU,而是一套“极端工况”的综合考验:1. 极端瞬态负载:AI 计算负载在空闲与满载之间的切换发生在纳秒级,核心电流可瞬间跃升至数百甚至上千安培。任何响应迟缓,都会引发电压跌落(Vdroop),直接影响计算稳定性。 2. 高热密度、长时间运行:700W 功耗集中在极紧凑的封装与模组空间内,GPU 周边长期处于 85–105°C 的高温环境,并且要求 7×24 小时不间断运行,对器件寿命提出极高要求。 3. 空间高度受限:GPU 与 HBM 占据了绝大多数板级空间,留给电源与去耦器件的区域极为有限,高容值、小体积、低 ESL/ESR成为硬性条件。

永铭解决方案

在这样的系统中,电容器早已不只是“滤波器件”,而是算力稳定性的关键基础设施:

瞬态能量支撑(Decoupling):在 VRM 尚未响应的瞬间,电容器提供关键的电流补偿,防止电压塌陷。

纹波与噪声抑制(Ripple Suppression):在 0.7–0.8V 的超低工作电压下,将电源噪声控制在毫伏级以内,保障计算精度。

系统级可靠性保障:在高温、高负载、长时间运行条件下,维持供电网络的长期稳定。

在 H200 这样的 AI 加速平台中,电容的可靠性,直接定义了算力的可持续性。对永铭而言,电容不只是独立器件,更是协同运作于AI服务器整个供电路径的能量系统。

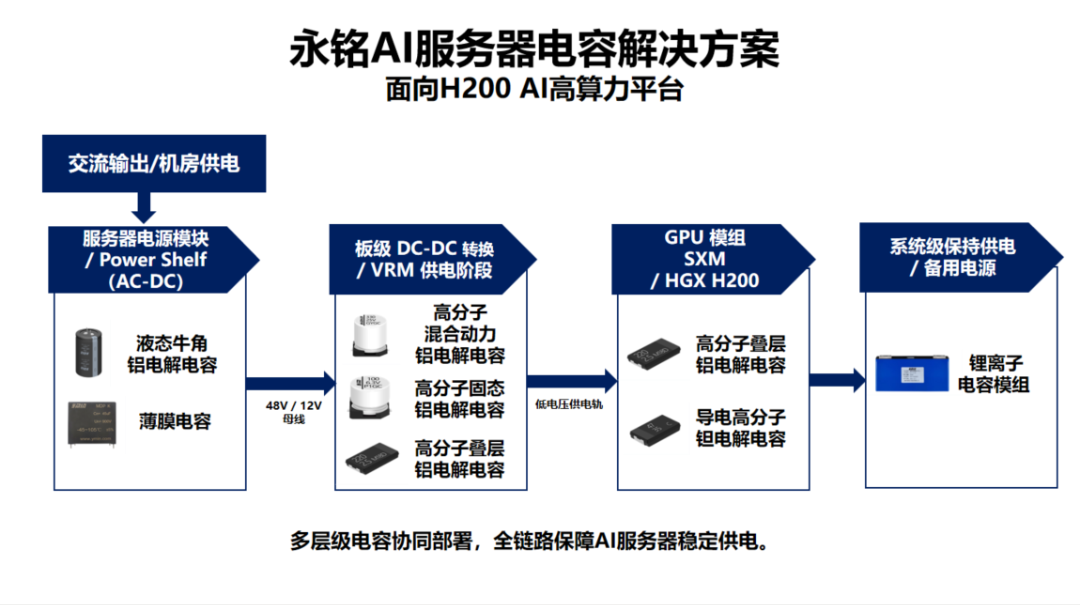

永铭AI服务器电容器解决方案思路

面对 H200 级别的挑战,单一类型电容已无法满足需求。

永铭提供的是一套覆盖“电源 → 板级 → GPU → 系统兜底”的完整电容解决方案:

图1:永铭AI服务器电容解决方案的供电示意图

永铭通过多种电容技术在不同电压层级与频段的协同部署,实现对极端瞬态负载、高热密度与 7×24 小时运行工况的稳定支撑。

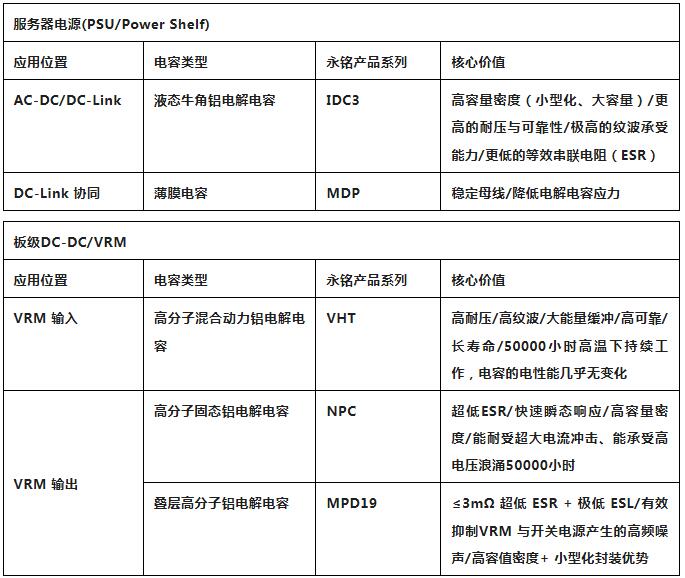

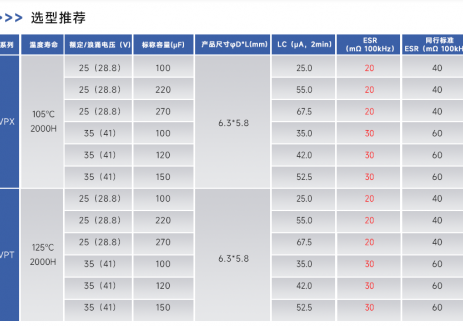

图2:运作于AI服务器整个供电路径的永铭产品系列推荐以及核心价值

结语:算力时代,稳定性同样重要

AI 算力的竞争,已经不再只是 GPU 制程与架构的竞争,更是供电网络可靠性的竞争。

在H200这样的高端 AI 平台中,一颗电容的性能与寿命,可能决定整台服务器的运行稳定性。永铭,专注于为AI 服务器提供可靠、可持续的电容解决方案,让每一瓦算力,都建立在稳定的电源基础之上。

切换行业

切换行业

正在加载...

正在加载...